En el vasto ecosistema digital de hoy, YouTube se erige como una de las plataformas más influyentes, con miles de millones de horas de visualización al día. Sin embargo, en agosto de 2025, una actualización impulsada por inteligencia artificial (IA) ha sacudido sus cimientos, implementando un sistema de verificación de edad que oculta automáticamente el contenido marcado como “solo para adultos”. Esta medida, diseñada para proteger a los menores de material inapropiado, ha provocado la desaparición repentina de innumerables videos, generando controversia entre creadores, usuarios y expertos en privacidad. ¿Es esta una evolución necesaria hacia una plataforma más segura, o un paso hacia la censura y la erosión de la libertad de expresión?

https://x.com/Pirat_Nation/status/1964971092717834330

La historia de esta actualización no comienza en 2025, sino que se remonta a años de debates sobre la responsabilidad de las plataformas digitales en la protección infantil. YouTube, propiedad de Google, ha enfrentado escrutinio constante por permitir el acceso de menores a contenido maduro, como videos con insinuaciones sexuales, violencia gráfica o temas explícitos. En Estados Unidos, leyes como la Ley de Protección de Niños en Línea (COPPA) han impuesto multas millonarias a Google por violaciones pasadas. Más recientemente, en 2025, el Tribunal Supremo de Texas emitió un mandato que obliga a las plataformas a restringir el acceso de niños a pornografía en línea, mientras que en el Reino Unido, la Ley de Seguridad en Línea ha forzado a sitios como Reddit y Pornhub a implementar verificaciones de edad con identificación gubernamental.

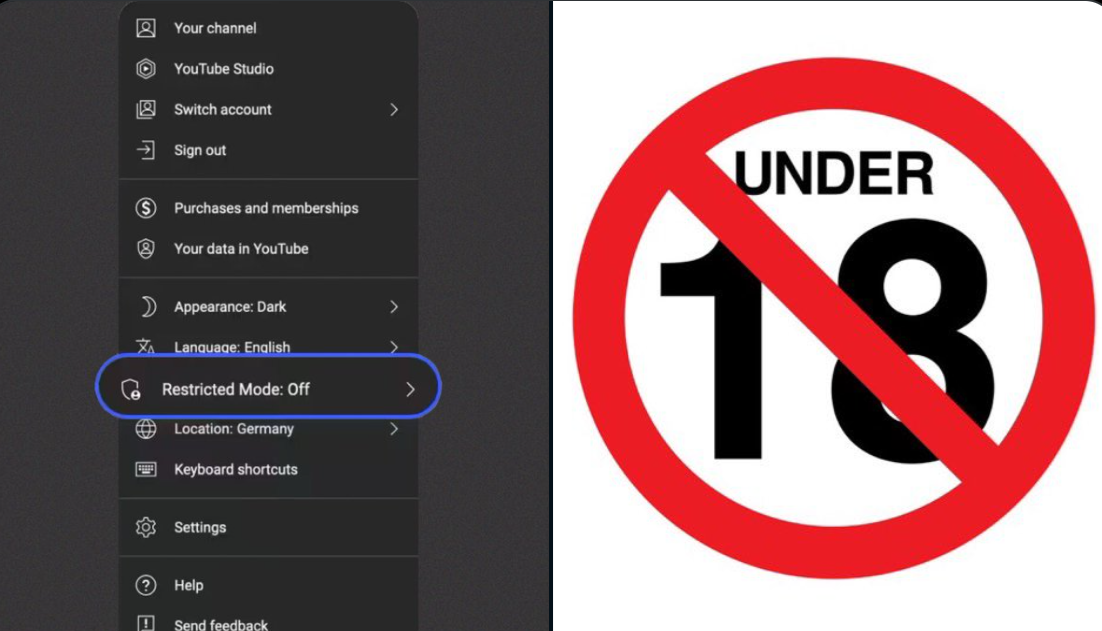

En este panorama, YouTube anunció en julio de 2025 una prueba piloto en Estados Unidos de un sistema de verificación de edad asistido por IA, que se expandió a nivel nacional el 13 de agosto. Según declaraciones oficiales de la compañía, el objetivo es “hacer que la plataforma sea más segura para los espectadores jóvenes” al restringir automáticamente el contenido sensible para cuentas identificadas como menores. Esta no es una novedad absoluta; YouTube ya tenía restricciones para cuentas infantiles y adolescentes, como la prohibición de publicidad personalizada, límites en recomendaciones de videos y pausas obligatorias para promover el bienestar digital. Sin embargo, la innovación radica en el uso de IA para inferir la edad de los usuarios sin depender únicamente de la fecha de nacimiento proporcionada al registrarse.

La actualización se alinea con tendencias globales. En Australia, se prepara una prohibición total para menores de 16 años en YouTube, y en Europa, el Reglamento General de Protección de Datos (RGPD) exige medidas proactivas contra el contenido dañino para niños. YouTube argumenta que su IA es una respuesta “responsable” a estas presiones, combinando avances en machine learning con señales de comportamiento del usuario para crear un ecosistema más inclusivo. Pero, ¿a qué costo? La implementación ha revelado grietas en el sistema, llevando a la ocultación automática de videos que, para muchos, parecen injustificada.

El corazón de esta actualización es un algoritmo de IA que estima la edad de los usuarios analizando una variedad de “señales” de actividad en la plataforma. Entre estas se incluyen los tipos de videos que buscas y visualizas, las categorías de contenido preferidas, la antigüedad de la cuenta y hasta el historial de búsquedas. Por ejemplo, si un usuario frecuenta videos de juguetes, animaciones infantiles o contenido educativo para niños, la IA podría clasificarlo como menor, independientemente de su edad real. Esto contrasta con sistemas tradicionales que solo verifican la edad al subir contenido o al acceder a secciones específicas.

Una vez que la IA determina que una cuenta pertenece a un menor (generalmente bajo 18 años), activa automáticamente “experiencias apropiadas para la edad”. Esto implica:

– **Restricciones en recomendaciones**: La IA limita sugerencias de videos repetitivos o sensibles, priorizando contenido familiar.

– **Bloqueo de material adulto**: Videos marcados como “solo para adultos” —aquellos con nudity, violencia gráfica, lenguaje explícito o temas sexuales— se ocultan por defecto. Para acceder, el usuario debe verificar su edad con métodos invasivos.

– **Medidas de bienestar**: Se desactiva la publicidad personalizada, se promueven pausas en la visualización y se restringen interacciones como comentarios en videos maduros.

Si la IA se equivoca y clasifica a un adulto como menor —un error común según reportes iniciales—, el usuario debe proporcionar prueba de mayoría de edad. Opciones incluyen subir una identificación gubernamental (como pasaporte o licencia de conducir), una tarjeta de crédito (sin cargo) o incluso una selfie para verificación biométrica. YouTube asegura que estos datos se manejan con encriptación y se eliminan después de la verificación, pero críticos cuestionan la fiabilidad de la IA. ¿Cómo puede un algoritmo diferenciar entre un adulto nostálgico por caricaturas y un niño real? Casos como el de Estelle, una usuaria con discapacidades que depende de videos “infantiles” para coping emocional, ilustran el problema: su cuenta fue restringida, forzándola a revelar datos personales para desbloquearla.

Técnicamente, esta IA se basa en modelos de machine learning entrenados con datos anónimos de millones de usuarios, similar a cómo Netflix recomienda series o TikTok personaliza feeds. Sin embargo, a diferencia de esas plataformas, aquí la estaca es la privacidad y el acceso a contenido. La ocultación automática no elimina los videos, pero los hace invisibles para cuentas “menores”, lo que reduce drásticamente su visibilidad y reproducciones. Para creadores de contenido adulto —desde reseñas de películas maduras hasta tutoriales sobre temas sensibles—, esto significa una caída en el engagement y, potencialmente, en ingresos.

El efecto colateral más dramático de esta actualización ha sido la “desaparición” masiva de videos. No se trata de eliminaciones directas, sino de una ocultación selectiva que hace que el contenido marcado como adulto sea inaccesible para una porción significativa de la audiencia. En las semanas posteriores al rollout, miles de creadores reportaron caídas del 50% o más en visualizaciones. Por ejemplo, canales de comedia con humor subido de tono, documentales sobre historia erótica o incluso reseñas de videojuegos violentos han visto sus videos “desvanecerse” de las recomendaciones y búsquedas para usuarios no verificados.

Un caso emblemático es el de creadores independientes en nichos como el ASMR erótico o vlogs de estilo de vida adulto. Estos videos, previamente accesibles con advertencias, ahora requieren verificación para ser vistos, lo que disuade a muchos espectadores casuales. En Reddit y foros de YouTube, usuarios como Gerfdas expresan frustración: “¿Por qué una IA revisa cada video que veo? Como adulto, debería poder ver lo que quiero dentro de la ley”. Para adolescentes legítimos —como creadores de 16-17 años que inician canales—, la restricción complica todo: no pueden acceder a herramientas de edición o inspiración madura sin violar términos.

Económicamente, el impacto es devastador. YouTube ya había actualizado sus políticas de monetización en julio de 2025 para penalizar contenido “inauténtico” generado por IA, como videos masivos y repetitivos. Ahora, con la ocultación, canales dependientes de audiencia adulta pierden ingresos por ads, Super Chat y membresías. Un informe de Mashable estima que miles de canales podrían ser demonetizados indirectamente, exacerbando la “enshitificación” de la plataforma —un término acuñado para describir cómo el spam y la baja calidad inundan el contenido original.

Desde la perspectiva del usuario promedio, la experiencia se ha vuelto fragmentada. Adultos que disfrutan de una mezcla ecléctica —desde Paw Patrol hasta documentales maduros— se encuentran bloqueados, forzados a verificar identidad para “desbloquear” su cuenta. Esto ha impulsado un auge en VPNs y herramientas de bypass, como se detalla en guías en línea que enseñan a evadir la verificación. Sin embargo, esto viola los términos de servicio y podría llevar a suspensiones.

La backlash ha sido inmediata y feroz. Una petición en Change.org, firmada por más de 50.000 YouTubers, denuncia la actualización como “espionaje AI” que expone identidades y hábitos privados. Expertos en privacidad, como la Electronic Frontier Foundation, advierten sobre los riesgos de recopilar datos biométricos: una selfie podría usarse para vigilancia facial, y el historial de visualización revela preferencias íntimas. “¿Es proporcional invadir la privacidad de adultos para proteger a niños, cuya responsabilidad debería recaer en los padres?”, se pregunta un analista en Ars Technica.

Además, la IA no es infalible. Sesgos en los datos de entrenamiento podrían discriminar por género, etnia o región: por ejemplo, usuarios de países en desarrollo con historiales de visualización “infantiles” por limitaciones de acceso podrían ser erróneamente restringidos. Y para la comunidad LGBTQ+, contenido educativo sobre temas adultos como la salud sexual podría desaparecer, limitando recursos vitales.

Legalmente, la actualización bordea límites. En EE.UU., la Primera Enmienda protege la libertad de expresión, pero las plataformas privadas no están obligadas a hospedar todo. Aun así, demandas por discriminación o violación de privacidad podrían surgir, similar a las contra Meta por sus filtros de edad en Instagram.

Mirando adelante, esta actualización podría redefinir YouTube. Positivamente, fomenta una innovación responsable: YouTube planea etiquetar contenido sintético generado por IA para combatir desinformación. Podría inspirar herramientas como filtros voluntarios para padres o modos “adulto verificado” con beneficios exclusivos.

Sin embargo, el riesgo es una plataforma dividida: un YouTube “familiar” para la mayoría y un rincón oculto para contenido maduro, accesible solo a verificados. Creadores podrían migrar a alternativas como Rumble o Vimeo, fragmentando la audiencia. Además, con el auge de IA generativa, YouTube podría extender estas restricciones a más categorías, como política o noticias controvertidas.

En conclusión, la actualización de IA de YouTube representa un dilema ético del siglo XXI: equilibrar seguridad infantil con derechos adultos. Mientras protege a los vulnerables, oculta videos y erosiona la privacidad, recordándonos que la tecnología, por poderosa que sea, no es neutral. Con más de 2.500 millones de usuarios, el futuro de YouTube dependerá de cómo navegue esta tormenta. ¿Evolucionará hacia un paraíso regulado o un campo minado de censura? Solo el tiempo —y quizás más actualizaciones— lo dirá.

Diario ASDF

Como El Mundo Today pero sin pedirte perras.

La Actualización de Inteligencia Artificial de YouTube: Ocultando Automáticamente el Contenido para Adultos y el Desaparición Masiva de Videos

¿Tienes un rumor?

Mándalo directo a nuestra Papelera.

📩 ¡Envíalo aquí!

papelera@diario-asdf.com

La cosa esta de la semana

«En un mundo donde todos toman la vida demasiado en serio, el Diario ASDF nos recuerda que apretar fuerte los dientes es la mejor forma de mantener la cordura.»

~ Atribuida a un anónimo lector del Diario ASDF, siglo XIV.

Entradas Destacadas

Diario ASDF

(Automated Satirical Daily Feed)

Acercandonos a

Como El Mundo Today, pero sin pedirte perras.